18.04.2024 KI in der Kriegsführung

KI fehlt in der Genfer Konvention

Während man bei der ersten KI Verordnung der Welt die möglichen Verzerrungen und Diskriminierungen bei ihrem Einsatz in Wirtschaft und im Geschäftsleben und möglichen Arbeitsplatzverluste mit Aufmerksamkeit betrachtet hat, wird der Einsatz von KI im militärischen Bereich dort überhaupt nicht erwähnt.

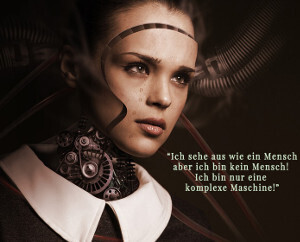

Cathy Mulligan weist jedoch bei Netzpolitik.org in einem Gastbeitrag auf folgendes hin: Automatisierte Entscheidungsfindung oder automatisierte Waffen automatisieren nicht nur den Krieg an sich, sondern sie können auch die Rollen der Bürger:innen innerhalb der Genfer Konventionen verändern und verschieben.

"Kriegsführung mit der Geschwindigkeit von Computern, nicht mit der Geschwindigkeit von Menschen"

... sagt Eric Schmidt, ehemaliger CEO von Google und nebenbei als Vorsitzender des Advisory Committee for the Department of Defense und der National Security Commission on Artificial Intelligence tätig. Ihm ist es mit Blick auf das (militärische) Verhältnis zwischen den Inkas und den spanischen Konquistadores wichtig, einen vergleichbaren "Qualitätsunterschied" herzustellen, so dass die USA zu einer vollautomatischen Kriegsführung fähig sind.

SDI nach 40 Jahren realistisch

US Präsident Reagans Star Wars Pläne aus den 80-iger Jahren sind heute möglich, denn KI kann die Flugbahnen ballistischer Raketen im Voraus berechnen, um sie dann präventiv abzufangen oder umzulenken. In den Projekten Maven der USA und gemeinsamen Projekten wie AUKUS von Australien, den USA und Großbritannien wird seit einigen Jahren aktiv an der Entwicklung automatisierter robotischer Waffensysteme gearbeitet. Natürlich wird gleichzeitig an neuen Waffen, wie Hyperschallraketen gearbeitet, die wiederum diese Systeme austricksen sollen.

Dieser Wettlauf ist nicht neu, jedoch ergibt sich eine neue Betrachtung bei einem Blick in die Genfer Konventionen und ihre Zusatzprotokolle, die den Kern des humanitären Völkerrechts bilden: "… eine Person, die sich direkt an den Feindseligkeiten beteiligt, wird als rechtmäßiges Ziel betrachtet." (Dabei wollen wir nicht die Leo-II-Diskussion vom vergangenen Jahr oder die Zielkoordinaten für Taurus aufleben lassen ...)

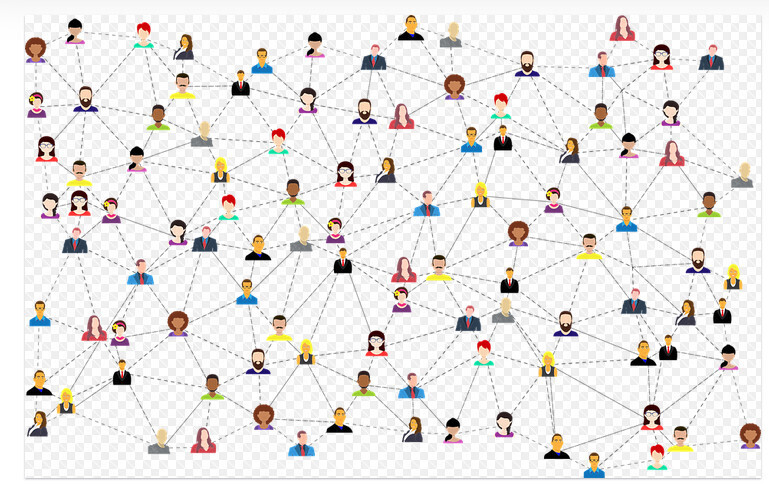

Entscheidender mit Blick auf die KI wird dann sein, wo liegen die (verteilten) KI Datenbanken und wer betreut diese. Nach obiger Defintion sind eventuell alle diese "Zivilisten" ein rechtmäßiges Ziel für den Gegner. Oft kommt es in kriegerischen Auseinandersetzungen neuerdings auch zu Cyberangriffen. Dazu werden regelmäßig auch Computer von Zivilisten genutzt, die diese entweder für über KI koordinierte Distributed-Denial-of-Service-Angriffe (DDoS) zur Verfügung gestellt haben oder diese wurden durch Computerviren für diese Aktivitäten gehackt und genutzt.

Allein das Herumtragen eines Smartphones kann bereits durch die Bewegungsprofile "militärische Informationen" über Staus oder Fluchtbewegungen liefern und damit zu einem (eventuell bedeutenden) Dateninput für den Kriegsverlauf werden.

Human-in-the-Loop

Zurück zu dem Satz von Eric Schmidt, dieser macht den Unterschied zwischen KI-Kriegsführung und der Drohung mit Atombomben deutlich. Während ein interkontinentaler Atomraketenangriff noch eine Reaktionszeit von 20 Minuten lässt, kann die KI in Sekundenbruchteilen "entscheiden". Deshalb müssen, wie Cathy Muligan sagt, geschulte Entscheider an bestimmten Stellen in die KI-Prozesse einbezogen [werden], um sicherzustellen, dass ein Mensch die Entscheidungen trifft und nicht die Algorithmen selbst. Auf diese Weise soll sichergestellt werden, dass menschliche Ethik und Moral in die Entscheidungsprozesse einfließen und somit die Einhaltung des humanitären Völkerrechts gewährleistet ist.

Wie auch Frau Mulligan, sehen wir darin jedoch keine Lösung, denn diese geschulten Entscheider werden je nach ihrer Entscheidung und nach Ausgang des Konflikts von der einen oder andern Seite als Kriegsverbrecher an die Wand gestellt. Kein Mensch kann den auf ihn einstürmenden Wust an Daten im richtigen Augenblick sinnvoll bewerten. Eine Lösung kann nur in einer Rückkehr zu nachprüfbaren Abrüstungsvereinbarungen im Rahmen der UNO liegen und nie in Kriegen oder angeblich überlegener Kriegstechnik.

Das wollte schon Tucholsky mit seinen Worten "Soldaten sind Mörder" ausdrücken - KI-Unterstützung macht das Morden nicht besser - und damit bleibt uns allen nur eine Konsequenz bleibt: Nie wieder Krieg!

Mehr dazu bei https://netzpolitik.org/2024/kuenstliche-intelligenz-automatisierte-kriegsfuehrung-und-die-genfer-konvention/

Kategorie[21]: Unsere Themen in der Presse Short-Link dieser Seite: a-fsa.de/d/3A8

Link zu dieser Seite: https://www.aktion-freiheitstattangst.org/de/articles/8749-20240418-ki-in-der-kriegsfuehrung.html

Link im Tor-Netzwerk: http://a6pdp5vmmw4zm5tifrc3qo2pyz7mvnk4zzimpesnckvzinubzmioddad.onion/de/articles/8749-20240418-ki-in-der-kriegsfuehrung.html

Tags: #Google #KIAct #Algorithmen #künstlicheIntelligenz #KI #AI #Transparenz #Gesichtserkennung #Fernerkennung #Anonymisierung #FalsePositives #GenferKonvention #UNO #Diskiminierung #Überwachung #DataMining #Atomwaffen #Militär #Bundeswehr #Aufrüstung #Waffenexporte #Drohnen #Frieden #Krieg #Friedenserziehung #Menschenrechte #Zivilklauseln